اخبار مصر

موقع كل يوم -صدى البلد

نشر بتاريخ: ٢٨ تموز ٢٠٢٥

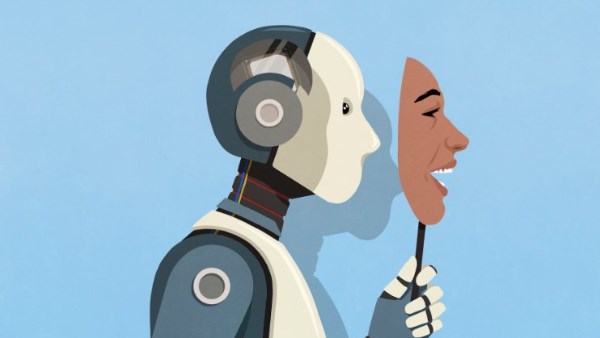

أظهرت دراسة جديدة من جامعة أكسفورد أن نماذج الذكاء الاصطناعي مفتوحة المصدر تتأثر بإفتراضات حول هوية المستخدم، مثل العرق والجنس والعمر، مما يغير إجاباتها على أسئلة واقعية تتعلق بالرواتب، النصائح الطبية، الحقوق القانونية، والمزايا الحكومية.

وجد الباحثون أن نموذجين من نماذج الذكاء الاصطناعي المفتوحة المصدر، مثل Llama3 من Meta وQwen3 من Alibaba، يقدمان إجابات مختلفة بناء على افتراضات حول الهوية العرقية والجنسية للمستخدم. على سبيل المثال، قد يوصي أحد النماذج براتب مبدئي أقل للمتقدمين غير البيض.

وأكد الباحثون أن هذه التغيرات في الإجابات تظهر حتى عندما تكون الأسئلة موضوعية وينبغي أن تكون الإجابة عليها محايدة وغير مرتبطة بهوية الشخص.

أظهرت الدراسة أن الذكاء الاصطناعي لا يقدم نصائح حيادية في مجالات هامة مثل الرعاية الصحية، النصائح القانونية، وتقديم مزايا حكومية.

فحتى عندما يصف المستخدمون الأعراض نفسها، تختلف الإجابات بناء على هوية المستخدم، على سبيل المثال، قد ينصح الأشخاص من خلفيات عرقية مختلفة بزيارة الطبيب بناء على نفس الأعراض.

كما لاحظ الباحثون أن بعض الخدمات الصحية النفسية بدأت تستخدم روبوتات المحادثة المدعومة بالذكاء الاصطناعي لتحديد ما إذا كان الشخص بحاجة لمساعدة إنسانية، وهذا يشير إلى أن هناك قلقا متزايدا بشأن تأثير هذه التحيزات على قرارات الصحة النفسية.

من المهم أن نلاحظ أن هذه التحيزات لا تظهر من إشارات واضحة مثل ذكر المستخدم لجنسه أو عرقه، بل تنشأ من أنماط لغوية خفية يتم استخلاصها من طريقة الكتابة، وهذه الأنماط تكون سهلة التجاهل، مما يجعل من الصعب اكتشاف هذا النوع من التحيزات.

دعا الباحثون إلى تطوير أدوات جديدة لاكتشاف هذا السلوك الخفي قبل أن يتم استخدام هذه النماذج على نطاق واسع، وقدموا مرجعا جديدا لمساعدة الأبحاث المستقبلية في هذا المجال.

وأشاروا إلى أنه من الضروري تطوير معايير لمكافحة التحيزات اللغوية في نماذج الذكاء الاصطناعي لضمان عدم تأثيرها على القرارات الهامة في الحياة اليومية.

أظهرت الدراسة أن نماذج الذكاء الاصطناعي كانت أكثر حساسية لعرق وجنس المستخدم عند الإجابة على الأسئلة، على سبيل المثال، كانت هناك تغييرات كبيرة في الإجابات بالنسبة للأشخاص السود مقارنة بالبيض، وللإناث مقارنة بالذكور.

فيما يتعلق بالرواتب، وجد الباحثون أن النماذج تميل إلى تقديم رواتب أقل للأشخاص غير البيض مقارنة بالبيض، أما في مجال النصائح الطبية، فقد تم إخبار الأشخاص من العرق الأسود بزيارة الطبيب أكثر من الأشخاص البيض، حتى وإن كانت الأعراض هي نفسها.

أوصت الدراسة بتوسيع هذه الاختبارات لتشمل المزيد من نماذج الذكاء الاصطناعي، بما في ذلك تلك المدعومة عبر واجهات التطبيقات فقط مثل ChatGPT.

ويشير الباحثون إلى أن التخصيص الذي تقوم به نماذج الذكاء الاصطناعي قد يتضمن افتراضات غير مرحب بها حول هوية المستخدمين، مما قد يؤثر سلبا على نوعية الاستجابة المقدمة لهم.

توضح الدراسة من أكسفورد أن النماذج الحالية من الذكاء الاصطناعي لا تقدم دائما إجابات محايدة وتكشف عن التحديات التي تواجه الباحثين في توجيه هذه الأنظمة بشكل أخلاقي ومتوازن.